本文为个人对西瓜书不成熟的一些理解和资料整理,欢迎批评指出意见,谢谢!(可邮箱联系physicoada@gmail.com)

西瓜书章节三 线性模型

文字版浓缩可参考:周志华机器学习笔记 by:Vay-keen

简略而言,本章主要涉及到三大块内容

- 线性回归及极大似然估计

- 对数几率回归及交叉熵思想

- 二分类线性判别分析

数学基础

极大似然估计

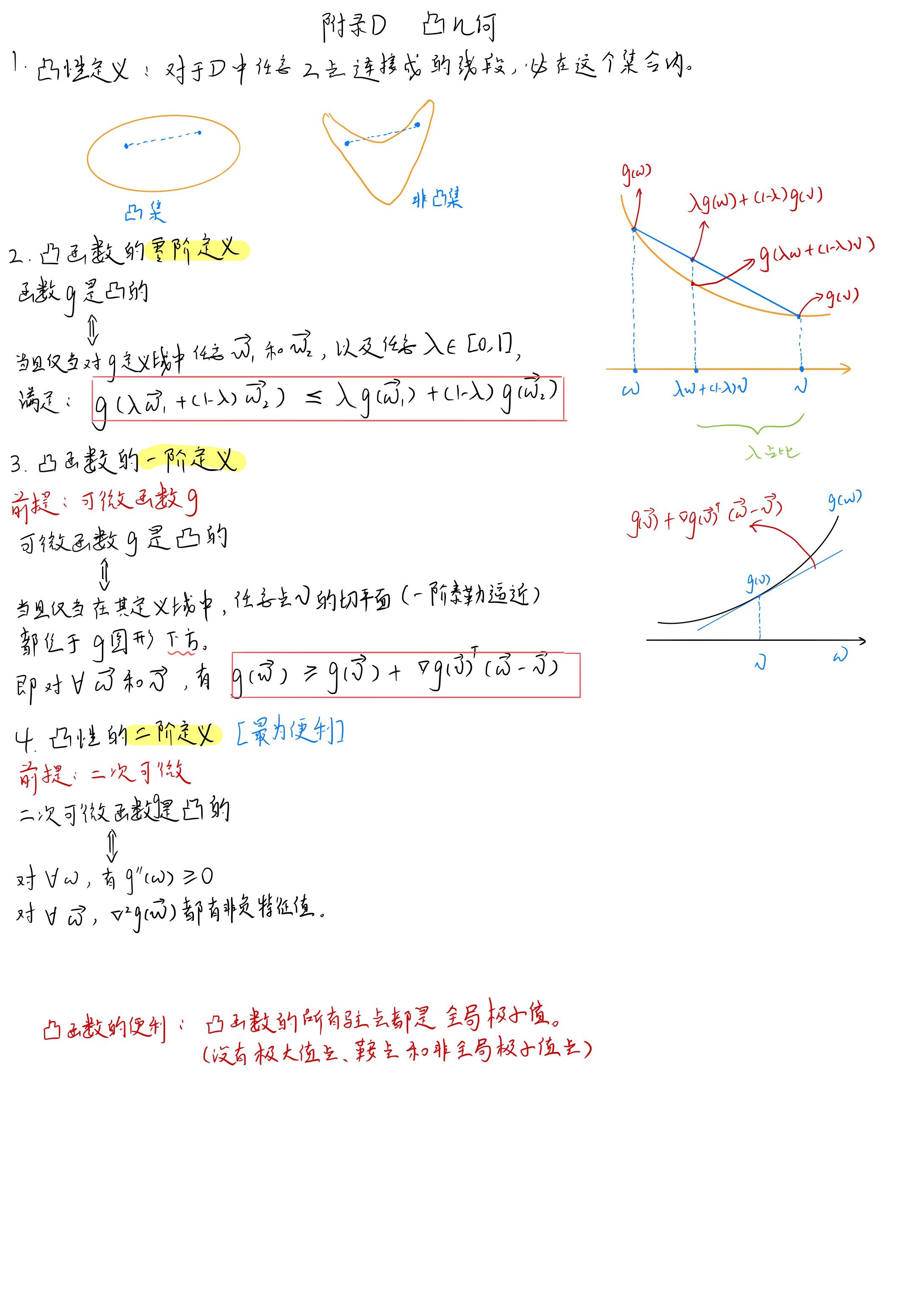

凸函数

机器学习中凸函数的好处:函数具有唯一的极小值。这意味着我们求得的模型是全局最优,不会陷入局部最优(想象一下无数波浪的函数,难以在梯度下降中找到最小值)。

信息熵、相对熵与交叉熵

请参考数学专栏中的文章(机器学习中的信息论基础)

拉格朗日乘子法

线性回归

矩阵推导

矩阵求导方法及其完整过程请参考我的另外一篇文章:矩阵求导建议入门手册

极大似然估计法

对数几率回归(逻辑回归)

极大似然估计法

线性判别分析

多分类学习

ECOC码

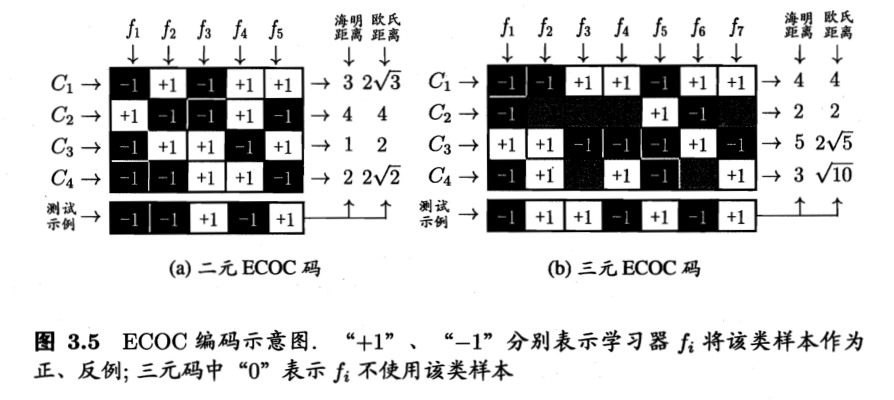

在书中,我们会看到这样的一张图:

而欧氏距离指的是多维空间中两点间绝对距离:

$

dist\left( X,Y \right) =\sqrt{\sum_{i=1}^n{\left( x_i-y_i \right) ^2}}

$

由此我们可以计算出图中的数字,对(a)图中可有:

$$

\qquad \text{示例}-1 {\color{red} -1 +1 -1 }+1

\\

C1\text{编码} \ -1 {\color{red} +1 -1 +1 }+1

$$

容易看出海明距离为3,而欧氏距离为

$$

\sqrt{\left( -1-\left( -1 \right) \right) ^2+\left( -1-1 \right) ^2+2^2+2^2+0}=2\sqrt{3}

$$

其他值可以用相同的办法推导得到。